Secondo una nuova ricerca, le persone che eseguono un’attività diagnostica medica assistita da un sistema di IA riprodurranno i pregiudizi del modello nelle proprie decisioni, anche quando si trovano a decidere senza supporto dell’IA.

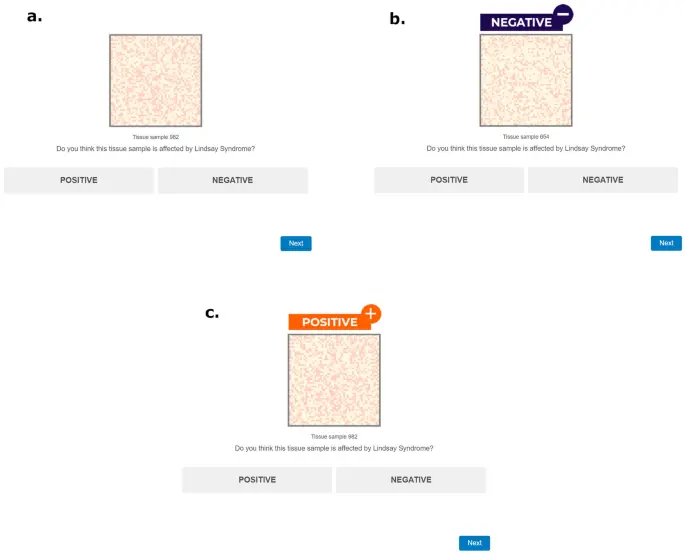

Nelle simulazioni delle ricercatrici Lucia Vicente e Helena Matute dell’università di Deusto a Bilbao in Spagna, i partecipanti hanno completato un compito di classificazione a tema medico con e senza l’aiuto di un sistema di IA. Le raccomandazioni distorte dell’IA hanno influenzato le decisioni dei partecipanti.

Inoltre, quando i partecipanti sono andati avanti a svolgere il compito senza l’assistenza dell’IA, hanno commesso gli stessi errori. Significa che le risposte dei partecipanti hanno imitato la polarizzazione dell’IA durante la fase precedente anche quando l’IA non stava più dando suggerimenti. Questi risultati forniscono la prova di una eredità umana della polarizzazione dell’ IA, proprio come un ‘pregiudizio ereditato’. Questo effetto non è stato osservato nei partecipanti del gruppo di controllo, che hanno risolto i compiti senza supporto dell’IA.

Questo è importante perchè sempre più professionisti stanno implementando strumenti basati sull’IA per supportare i processi decisionali, essenzialmente per ridurre gli errori delle loro decisioni. Come sappiamo, i modelli di IA riflettono le decisioni umane passate. Se i dati nascondono errori sistematici, l’algoritmo IA imparerà e riprodurrà questi errori. Quindi, i sistemi di IA ereditano ed amplificano i pregiudizi umani.

Le ricerche di Vicente e Matute ora indicano che questo funziona anche al contrario, che gli esseri umani ereditano pregiudizi dall’IA. Ciò costituisce un rischio elevato in quanto la società umana rischia ad restare intrappolata in un circolo vizioso di errori applicati costantemente.

I risultati sollevano gravi questioni etiche e giuridiche. Mostrano che abbiamo bisogno delle regole per garantire un’IA etica ed equa, considerando non solo le caratteristiche tecniche dell’IA ma anche gli implicazioni sociali e psicologiche.

(Correzioni per un errore di battitura. Articolo in inglese.)

Step 1) Le AI ereditano i bias umani perchè apprendono da una statistica di valutazioni umani. Step 2) Gli umani si fidano delle AI e prendono a modello i loro suggerimenti e i loro bias. Step 3) Riparti dal primo step fino a reificazione del bias a norma nascosta.